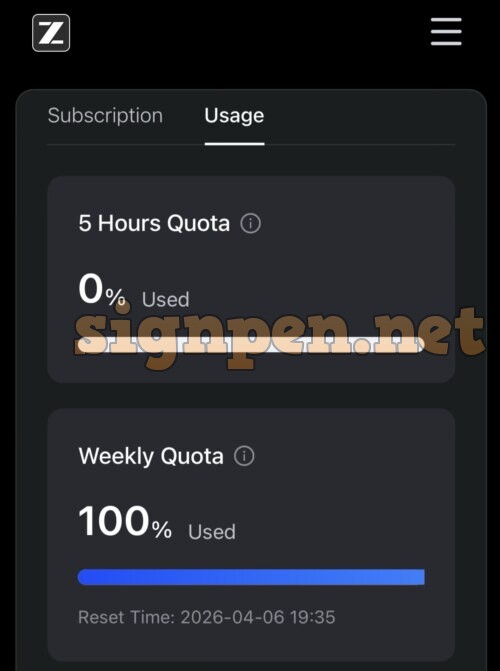

GLM 코딩플랜 Pro로 업그레이드하고 나서 쿼터가 넉넉해졌다. 5시간 쿼터, 7일 쿼터 모두 여유가 생기니 자연스럽게 새로운 걸 시도해보고 싶어졌다. 그렇게 oh-my-opencode(이하 OMO)에 손을 대기 시작했다.

목차

opencode로 달라진 퇴근 후 루틴

OMO 이야기를 하기 전에 먼저 opencode 얘기를 조금 해야 한다.

나는 Python Django 기반의 개인 프로젝트로 웹사이트를 만들고 있다. 아니, 정확히는 “만들려고 하고 있었다”는 표현이 맞다. 퇴근 후 개인 프로젝트를 하다 보면 누구나 한 번쯤 겪는 패턴이 있다.

“신나게 개발” → “한동안 못 봄” → “다시 소스 열어봄” → “어디까지 했는지 분석” → “분석만 하다 끝남” → “개발에 의욕 상실” → 결국 프로젝트가 디스크 한 구석에 방치됨

이게 반복되면서 프로젝트가 뼈대만 완성된 채로 묻혀버린 경험, 한 번쯤은 있지 않나.

opencode가 이 사이클을 끊어줬다. 어디까지 개발됐는지 내가 직접 분석할 필요가 없어졌다. 앞으로 고쳐야 할 것, 구현해야 할 것만 핸드폰 메모장에 적어두면 그만이다. 퇴근하고 ToDo 리스트를 하나씩 시키면, opencode가 작업하는 동안 나는 집안일을 한다. 완료되면 결과물만 테스트하면 된다.

가족 눈치 안 보고 개인 프로젝트 진행이 가능해진 거다.

oh-my-opencode(OMO)란 무엇인가, 그리고 처음엔 완전히 헤맸다

쿼터에 여유가 생기자 OMO가 눈에 들어왔다. 처음엔 막연한 거부감이 있었다. “여러 에이전트를 동시에 쓰면 토큰 소모가 엄청나겠지”라는 생각 때문이었다. 하지만 넉넉해진 쿼터가 그 장벽을 낮춰줬다.

설치는 생각보다 간단했다

설치 가이드부터 남달랐다. 사람이 직접 설치하지 말라고 되어 있다. AI가 읽고 설치 작업을 할 수 있는 프롬프트 문구를 제공하는 방식이다. 그 프롬프트를 복사해서 opencode에 붙여넣고 엔터를 치자 자동으로 플러그인 설치가 시작됐다.

앞으로는 이런 방식의 설치가 자연스러운 시대가 오지 않을까.

잠깐 그런 생각이 들었다.

설치가 끝나면 사용 중인 LLM 서비스 키를 입력하는 순서가 나온다. OpenAI, Gemini CLI 등 메이저 서비스 목록이 쭉 나오다가 내가 쓰는 z.ai도 선택할 수 있었다. 선택하니 OMO가 GLM 플랜에서 사용 가능한 모델들로 각 에이전트를 자동 세팅해줬다.

처음엔 아틀라스를 붙잡고 “해줘”만 반복했다

opencode에는 플랜 모드, 빌드 모드 딱 두 가지였다. 심플하고 이해하기 쉬웠다. 그런데 OMO를 열자 프로메테우스, 헤파이스토스, 시지푸스, 아틀라스… 이런 이름들이 나타났다.

어디서부터 시작해야 할지 전혀 감이 안 왔다. 그래서 처음에 좀 헤맸다. 지금 생각하면 웃기지만, 아틀라스 하나 붙잡고 “OOO 기능 만들어줘”를 반복했다. 당연히 제대로 동작하지 않았다. 아틀라스에게 그런 요청을 하는 건 잘못된 사용법이었다.

만들어진 계획을 실행해야 하는 아틀라스가 계획이 없으니 즉흥적으로 내가 요청한 내용을 실행하는 형태로 작동했다.

OMO 제대로 쓰는 법 — 두 가지 방식

한참 헤맨 뒤에야 사용 방식을 이해했다. 크게 두 가지 흐름이 있다.

방법 1. 프로메테우스와 계획 세우기

- 프로메테우스에게 “OOO 기능 만들어줘”라고 요청한다

- 프로메테우스가 현재 소스를 분석하고, 기능 구현을 위한 작업 계획을 수립한다

- 요구사항이 애매한 부분은 사용자에게 직접 질문한다

- 분석과 인터뷰를 바탕으로 개발 플랜을 완성한다

- 플랜이 나오면 아틀라스로 전환해서

/start-work명령어 한 줄만 입력하면 개발이 시작된다

방법 2. 시지푸스에게 바로 요청하기

시지푸스를 선택하고 “OOO 기능 만들어줘”라고 하면 끝이다. 애매한 요청사항도 시지푸스가 알아서 판단해서 진행한다.

나는 대부분 프로메테우스와 계획을 먼저 세우는 방식으로 작업하고 있다. 결과물이 대체로 마음에 든다.

각 에이전트마다 최적 모델이 따로 있다

한 가지 중요한 포인트가 있다. OMO는 모든 에이전트에 최고 성능 모델을 쓴다고 최고의 결과물이 나오지 않는다. 에이전트마다 역할이 다르고, 그 역할에 최적화된 권장 LLM 모델이 따로 있다.

자세한 내용은 OMO 공식 가이드에서 확인할 수 있다.

초기에는 GLM 모델만으로 세팅해서 썼다. 그런데 이후 GitHub Copilot Pro($10/월, 첫 달 무료)를 추가하니 상황이 달라졌다. Copilot은 GPT뿐만 아니라 Opus, Sonnet, Gemini 등 다양한 모델을 지원한다. 월 300회 프리미엄 호출 제한이 있지만, OMO에 연결하니 각 에이전트에 권장 모델을 제대로 배치할 수 있었다. 작업 결과물의 퀄리티가 눈에 띄게 달라졌다.

한 주 동안 주간 사용량을 꽉 채워서 2억 토큰 넘게 써본 적도 있다.

그리고 요금제가 날 배신했다

이쯤에서 좋은 이야기는 끝난다.

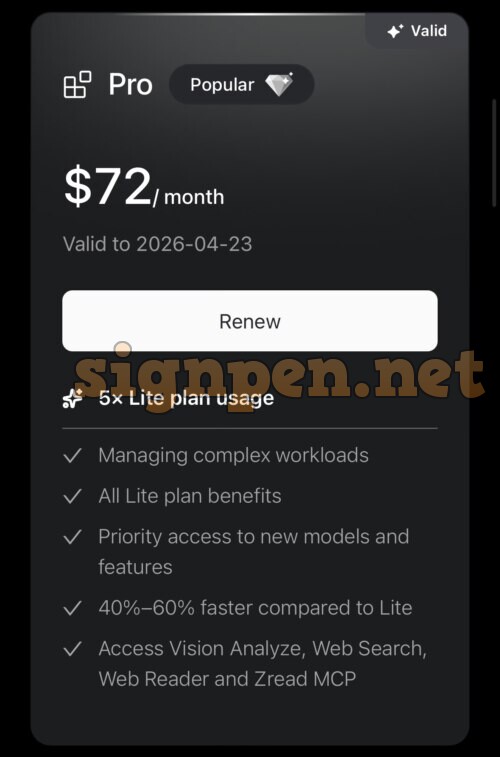

4월 10일경, z.ai가 GLM 코딩플랜 요금을 갑자기 2배로 인상했다. 때마침 새로 출시된 GLM 5.1 모델이 성능 면에서 좋은 평가를 받고 있던 시점이었다. 그 자신감이었는지, 아니면 다른 이유가 있었는지 모르겠지만 요금이 확 뛰었다.

4월 25일경에는 GitHub Copilot도 요금 정책 개편을 발표했다. 사용량 기반 과금으로 전환되면서 예전의 메리트가 사라졌다.

변경 전 내가 그린 그림:

- GLM 코딩플랜 Pro $30 + Copilot Pro $10 = 월 $40

- 이 정도면 충분히 써볼 만하다고 생각했다

변경 후 현실:

- GLM 코딩플랜 Pro → $72

- Copilot → 사용량 기반 과금으로 메리트 소멸

$72면 대략 10만원이다. GLM 모델이 좋다는 건 어디까지나 가성비가 좋다는 얘기지, 절대적인 품질이 월등한 건 아니다. 게다가 중국 서비스라는 특성상 내 데이터에 대한 찜찜함이 늘 마음 한 구석에 있었다.

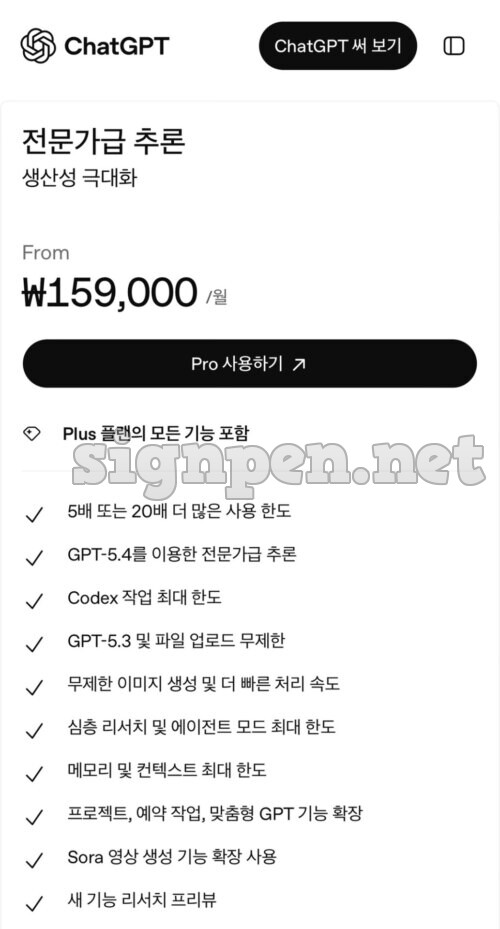

그렇게 계산하다 보니 결론이 이상한 방향으로 흘렀다. 10만원 내면서 찜찜한 서비스를 쓰느니, 5만원 더 주고 제대로 된 품질의 서비스를 쓰는 게 낫겠다는 생각이 들었다. 결국 지금은 OpenAI GPT Pro(약 15만원/월) 를 구독하고 있다.

내 계산 방식이 이상한 건지 모르겠지만, 어쩌다 보니 이렇게 됐다.

더 최근의 근황은 다음 글에서 이어서 작성해보겠다.